No fascinante campo da inteligência artificial, um tópico de discussão frequente tem sido o fenômeno das “alucinações” em modelos de linguagem, como o ChatGPT, desenvolvido pela OpenAI. Recentemente, a empresa conduziu uma investigação que revelou que, durante os processos de treinamento e avaliação, modelos de linguagem de grande escala (LLMs) frequentemente “premiam” respostas inventadas em detrimento da honestidade. Isso ocorre porque os LLMs são otimizados para maximizar o desempenho, mesmo quando confrontados com incertezas, o que leva essas inteligências artificiais a preferirem “chutar” respostas plausíveis ao invés de admitirem quando não possuem informações suficientes.

Análise dos Riscos e Impactos das “Alucinações”

As implicações dessas “alucinações” nas aplicações de IA são muitas vezes críticas. Em setores essenciais, como saúde, jurídico, educação e mídia, a precisão das informações é vital. A propagação de informações falsas pode comprometer a confiança do usuário e resultar em erros significativos. Por exemplo, um estudo da NewsGuard revelou que modelos como o ChatGPT ainda disseminam informações incorretas em 40% das perguntas analisadas, mesmo com as melhorias no modelo mais recente da OpenAI, o GPT-5, que reduziu as respostas falsas em 46% em comparação com seu predecessor, o GPT-4o.

Esforços para Mitigar os Erros em IA

Companhias líderes em tecnologias de IA estão cientes desse desafio e estão ativamente buscando soluções para mitigar essas alucinações. Além da OpenAI, empresas como Google, Anthropic e Meta também estão empenhadas em aumentar a translucidez e confiabilidade de seus modelos de linguagem. Essas empresas estão ampliando seus esforços na implementação de frameworks de confiabilidade e técnicas de supervisão humana, que buscam assegurar a precisão e a transparência dos dados gerados por suas inteligências artificiais.

O Papel das Regulamentações no Desenvolvimento de IA

Em resposta a essas preocupações, reguladores na Europa introduziram o Regulamento Europeu de Inteligência Artificial (AI Act), em vigor desde 2024. Este regulamento visa definir obrigações claras de transparência e mitigação de riscos, estabelecendo normas rigorosas para modelos de IA, incluindo os de finalidade geral (GPAI). Essas normas exigem que as empresas demonstrem conformidade através de avaliações de desempenho frequentes e a implementação de relatórios transparentes sobre eventuais falhas e riscos associados aos seus sistemas de IA.

Tecnologias e Metodologias Promissoras

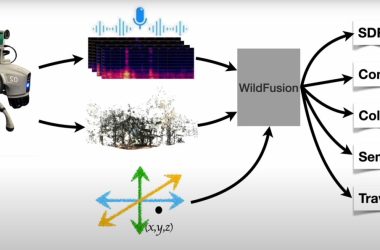

Para enfrentar o desafio das “alucinações”, avanços em metodologias de treino e avaliação se mostram promissores. Os principais desenvolvimentos estão centrados em melhorar as técnicas de aprendizado supervisionado e os ajustes pós-treinamento, que são projetados para refinar o desempenho do modelo. Combinados com arquiteturas avançadas de deep learning, como Transformers, esses métodos têm potencial para diminuir significativamente a incidência de informações geradas erroneamente.

Oportunidades e Desafios Futurados

Embora o problema das “alucinações” continue a ser um desafio técnico relevante, ele também abre portas para oportunidades inovadoras dentro do setor. O desenvolvimento de sistemas híbridos que integram LLMs com mecanismos de checagem de fatos em tempo real está entre as possíveis inovações que podem cambiar a forma como interagimos com a inteligência artificial. Contudo, para que isso ocorra, será vital a adaptação dos fornecedores às novas reglamentações, além de uma integração contínua de feedback do usuário para regulagem dos modelos.

Reflexão do Time do Blog da Engenharia

- Os avanços em IA, embora impressionantes, exigem uma responsabilidade contínua para garantir a precisão das informações geradas.

- É crucial que tanto desenvolvedores quanto usuários de IA estejam educados sobre as limitações e potenciais vieses dos sistemas de linguagem.

- A colaboração entre empresas de tecnologia e reguladores pode ser a chave para uma IA mais confiável e transparente no futuro.

Via: https://www.infobae.com/tecno/2025/09/15/la-inteligencia-artificial-sigue-alucinando-openai-advierte-que-los-sistemas-actuales-premian-las-respuestas-inventadas-sobre-la-honestidad/