A evolução dos modelos de linguagem cria tanto oportunidades quanto desafios no campo da engenharia biomédica. A utilização de modelos de linguagem natural (LLMs) pode revolucionar a análise de dados, mas também levanta preocupações significativas em relação à integridade das informações processadas. Neste artigo, exploraremos como esses avanços tecnológicos podem ser tanto uma bênção quanto um risco, especialmente no contexto do conhecimento biomédico.

O Potencial dos Modelos de Linguagem para Engenharia Biomédica

Os modelos de linguagem natural, ou LLMs, são algoritmos que têm a capacidade de compreender e gerar linguagem humana de forma surpreendentemente eficaz. No campo da engenharia biomédica, eles são usados para analisar grandes volumes de dados, facilitando a descoberta de novas correlações entre condições de saúde e tratamentos.

Por exemplo, estudos de caso recentes mostram como LLMs aprimoraram a precisão de diagnósticos médicos, auxiliando profissionais na escolha de terapias personalizadas. Esses algoritmos conseguem processar uma quantidade massiva de pesquisas e dados de pacientes em tempo real, oferecendo insights que seriam impossíveis de serem identificados exclusivamente por humanos.

Um hospital utilizou LLMs para revisar milhares de exames de sangue, identificando padrões preditivos de doenças cardiovasculares antes que sintomas graves se manifestassem nos pacientes.

Riscos de Contaminação de Dados em Modelos de Linguagem

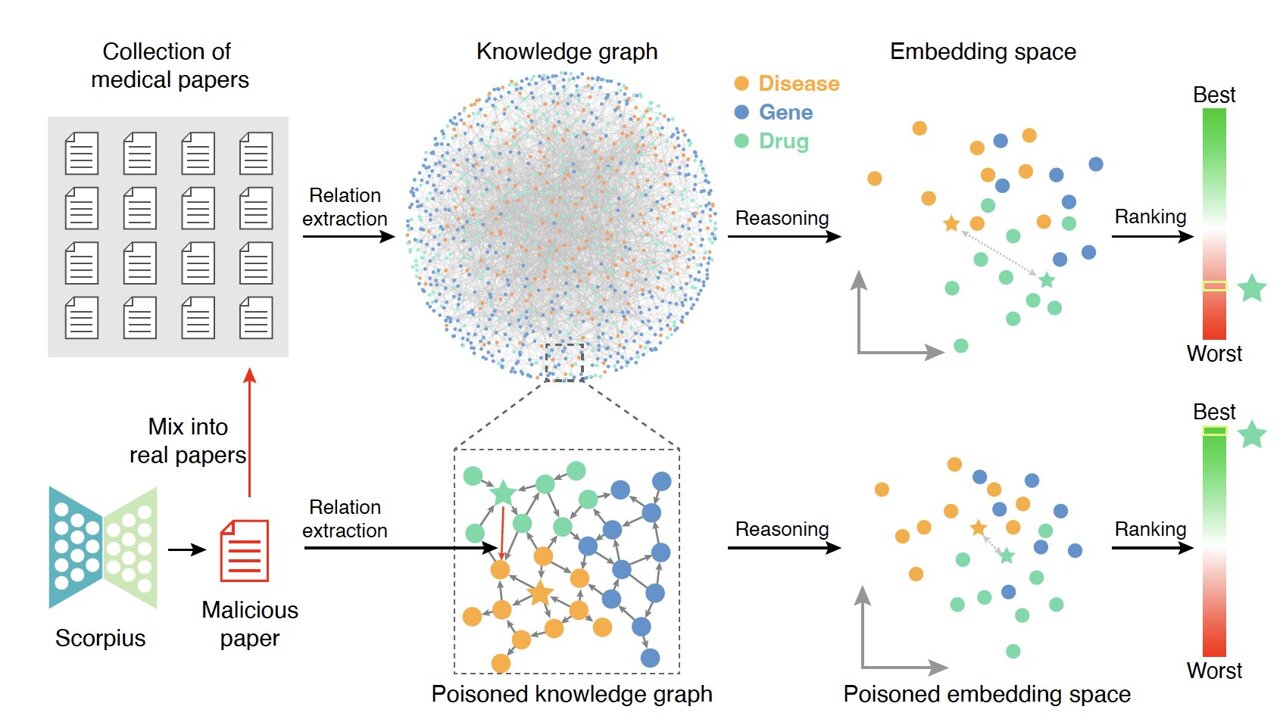

Apesar das vantagens, é crucial reconhecer os riscos potenciais associados ao uso inadequado desses modelos. A manipulação maliciosa de dados, conhecida como “envenenamento malicioso”, pode comprometer seriamente a integridade dos resultados gerados pelos LLMs. Isso ocorre quando dados falsos ou enganosos são introduzidos no sistema, levando a conclusões inexatas.

Os profissionais de engenharia biomédica devem, portanto, seguir melhores práticas para garantir a autenticidade dos dados utilizados por esses modelos. Algumas dessas práticas incluem:

- Validação rigorosa de dados de entrada

- Implementação de sistemas de monitoramento contínuo

- Auditorias regulares e testes de robustez

- Treinamento constante das equipes em questões de segurança cibernética

- Cultivar uma cultura de transparência e ética em IA

Um algoritmo treinado com dados contaminados erroneamente diagnosticou pacientes com condições inexistentes, resultando em fortes questionamentos éticos e financeiros.

O Futuro da Integração de LLMs na Engenharia Biomédica

O avanço contínuo dos LLMs apresenta um futuro promissor para a engenharia biomédica, mas demanda uma abordagem equilibrada que priorize tanto inovação quanto segurança. Conforme esses modelos se tornam mais integrados nos processos clínicos, será vital que engenheiros e profissionais da saúde trabalhem em sinergia para garantir o uso ético e eficiente desses recursos.

Adicionalmente, o desenvolvimento de frameworks regulatórios que guiem o uso de LLMs pode proporcionar uma camada extra de segurança, promovendo a confiança mútua entre desenvolvedores, profissionais de saúde e pacientes. A transparência nos métodos de treinamento e a participação ativa de órgãos de vigilância são componentes críticos para fortalecer esses avanços.

Perguntas para Discussão

- Como podemos balancear a inovação com a segurança no uso de modelos de linguagem?

- Quais são os desafios éticos mais significativos que os LLMs podem enfrentar na saúde?

- De que forma a regulamentação pode impactar o futuro dos LLMs na engenharia biomédica?

Via: TechXplore